Cómo hacer scraping web con Python y BeautifulSoup

Cómo hacer scraping web con Python y BeautifulSoup

¿Alguna vez has necesitado extraer datos de un sitio web de manera automatizada? Si eres un entusiasta de la programación o un profesional en busca de información valiosa, el scraping web con Python y BeautifulSoup puede ser tu mejor aliado. Esta técnica te permite recolectar datos de páginas web de forma eficiente, ya sea para análisis de datos, monitoreo de precios o investigación. Python, con su simplicidad y potencia, junto a la librería BeautifulSoup, hace que este proceso sea accesible incluso para principiantes. En este artículo, exploraremos cómo realizar scraping web paso a paso, desde la instalación de las herramientas necesarias hasta la extracción de datos específicos. ¡Prepárate para sumergirte en el fascinante mundo del web scraping con Python y descubre cómo automatizar tareas repetitivas de manera efectiva!

Primeros pasos para el scraping web con Python

Antes de sumergirnos en el código, es fundamental entender los conceptos básicos y preparar nuestro entorno de trabajo para realizar scraping web con Python. Este proceso implica extraer datos de sitios web de forma estructurada, pero requiere ciertas herramientas y consideraciones éticas. En esta sección, abordaremos cómo configurar tu entorno de desarrollo con Python y las librerías necesarias, así como las bases para comenzar de manera responsable y eficiente en el mundo del web scraping.

Instalación de Python y librerías esenciales

El primer paso para hacer scraping web es asegurarte de tener Python instalado en tu computadora. Puedes descargarlo desde el sitio oficial de Python y elegir la versión más reciente (como Python 3.9 o superior). Una vez instalado, necesitarás dos librerías clave: BeautifulSoup para parsear el HTML y Requests para realizar solicitudes HTTP. Instálalas fácilmente usando pip con los comandos pip install beautifulsoup4 y pip install requests. Estas herramientas te permitirán acceder a páginas web y extraer datos de manera sencilla. Asegúrate de tener un entorno virtual configurado para evitar conflictos entre proyectos, y con esto estarás listo para dar el siguiente paso en tu aventura de scraping con Python.

Consideraciones éticas y legales del scraping

Antes de comenzar a extraer datos, es crucial entender las implicaciones éticas y legales del web scraping. No todos los sitios web permiten esta práctica, y muchos tienen términos de servicio que prohíben la recolección automatizada de datos. Revisa siempre el archivo robots.txt de un sitio para saber si el scraping está permitido. Además, evita sobrecargar los servidores haciendo solicitudes con pausas razonables entre ellas. Respeta la privacidad de los datos y no uses la información recolectada para fines maliciosos. Al hacer scraping web con Python, prioriza la responsabilidad para evitar problemas legales y contribuir a un uso ético de la tecnología.

Construyendo tu primer script de scraping con BeautifulSoup

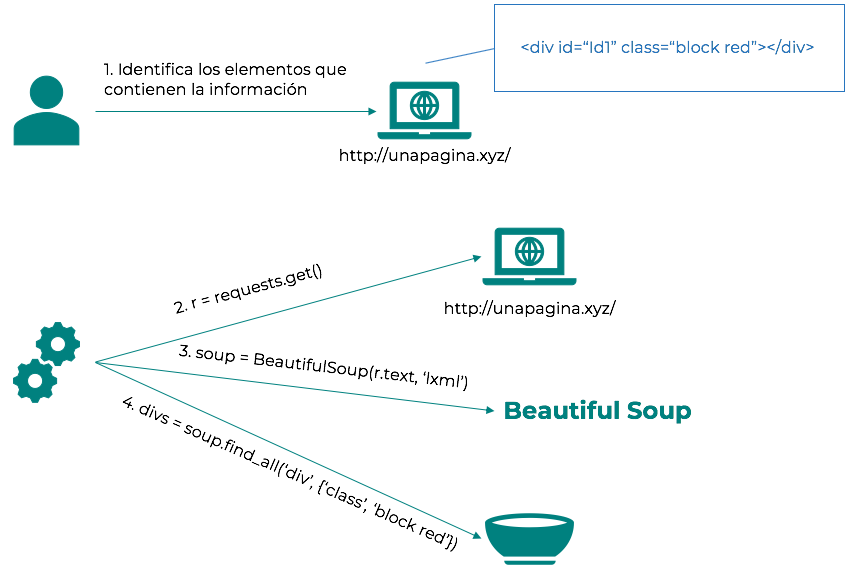

Ahora que tienes tu entorno configurado y conoces las bases éticas, es momento de poner manos a la obra y escribir tu primer script de scraping web con Python y BeautifulSoup. Esta librería es ideal para analizar el código HTML de una página y extraer la información que necesitas. En esta sección, te guiaremos a través de los pasos básicos para crear un script funcional, desde realizar una solicitud a un sitio web hasta parsear los datos obtenidos de manera efectiva.

Realizando una solicitud HTTP con Requests

El primer paso en cualquier proyecto de scraping web con Python es obtener el contenido de una página. Para ello, usamos la librería Requests. Comienza escribiendo un script simple que haga una solicitud GET a una URL específica. Por ejemplo, puedes usar el código import requests; response = requests.get('https://ejemplo.com'). Si la solicitud es exitosa, obtendrás el código HTML de la página en response.text. Es importante verificar el estado de la respuesta con response.status_code para asegurarte de que no haya errores (un código 200 indica éxito). Este contenido HTML será la base para el siguiente paso, donde BeautifulSoup entrará en acción para analizarlo y extraer datos específicos.

Parseando HTML con BeautifulSoup

Una vez que tienes el HTML de la página, BeautifulSoup te ayuda a navegar y extraer información de manera sencilla. Importa la librería con from bs4 import BeautifulSoup y crea un objeto con soup = BeautifulSoup(response.text, 'html.parser'). Ahora puedes buscar elementos específicos usando métodos como find() o find_all(). Por ejemplo, si quieres extraer todos los títulos de una página, usa titulos = soup.find_all('h1'). BeautifulSoup te permite filtrar por etiquetas, clases o IDs, haciendo que el scraping web con Python sea increíblemente flexible. Con un poco de práctica, podrás recolectar datos como textos, enlaces o tablas en pocos pasos.

AvANZANDO en técnicas de scraping y manejo de datos

Con los fundamentos bajo control, es hora de explorar técnicas más avanzadas para optimizar tu scraping web con Python y BeautifulSoup. No siempre los datos están perfectamente organizados, y los sitios web pueden tener estructuras complejas o protecciones contra bots. En esta sección, aprenderás cómo manejar desafíos comunes y cómo organizar los datos extraídos para su uso posterior en análisis o proyectos más grandes.

Cómo conectarse a bases de datos con Python y SQLiteManejando páginas dinámicas y retrasos

Algunos sitios web cargan contenido de manera dinámica usando JavaScript, lo que significa que una simple solicitud con Requests no siempre funciona. En estos casos, puedes combinar Python con herramientas como Selenium para simular un navegador y acceder al contenido renderizado. Además, para evitar ser bloqueado por hacer demasiadas solicitudes, incorpora retrasos en tu script con la librería time usando time.sleep(2) entre cada petición. Este enfoque te ayudará a realizar scraping web de manera más segura y efectiva, respetando los límites de los servidores y obteniendo datos incluso de sitios complejos. Recuerda que la paciencia es clave en proyectos avanzados de scraping con Python.

Almacenando y organizando datos extraídos

Después de extraer datos con BeautifulSoup, el siguiente paso es organizarlos para su uso. Puedes guardarlos en formatos como CSV o JSON usando librerías de Python como csv o json. Por ejemplo, para guardar datos en un archivo CSV, crea una lista con los elementos extraídos y usa csv.writer para escribirlos en un archivo. Esto es ideal para análisis de datos o para integrarlos en otros proyectos. También puedes usar pandas para manipular los datos en forma de DataFrame antes de exportarlos. Al dominar el almacenamiento de datos, tu scraping web con Python se convierte en una herramienta poderosa para cualquier tarea de recolección y análisis de información.

Hemos recorrido un camino emocionante aprendiendo cómo hacer scraping web con Python y BeautifulSoup. Desde la configuración inicial hasta la creación de scripts básicos y técnicas avanzadas, ahora tienes las herramientas necesarias para extraer datos de sitios web de manera eficiente y responsable. Recuerda siempre respetar las normas éticas y legales al realizar scraping, y no olvides optimizar tus scripts para manejar grandes volúmenes de datos o páginas dinámicas. Con práctica, el web scraping puede abrirte puertas a proyectos de análisis de datos, automatización y mucho más. ¿Estás listo para poner en práctica lo aprendido? ¡Comienza a explorar el scraping con Python hoy!

Qué es Flask y cómo crear tu primer API en PythonSi quieres conocer otros artículos parecidos a Cómo hacer scraping web con Python y BeautifulSoup puedes visitar la categoría Guias Python.

Entradas Relacionadas